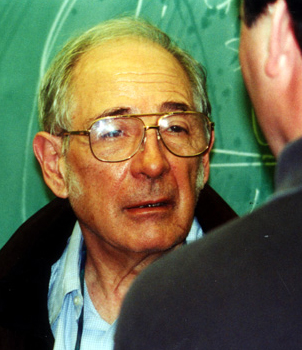

John Rogers Searle è famoso per aver concepito l'esperimento mentale chiamato "Stanza Cinese". Con questo esperimento egli vuole dimostrare che nessun computer può "pensare" nello stesso modo degli esseri umani. Il suo principale presupposto è che il computer, per elaborare l'informazione, non ha bisogno di comprendere.

Principio fondamentale per la differenza tra cervello e sistema: la consapevolezza è frutto dell'attività fisica specifica di un sistema fisico specifico (il cervello). Benché questa attività possa essere simulata da un computer, questa non può far sorgere la consapevolezza.

Principio fondamentale per la differenza tra cervello e sistema: la consapevolezza è frutto dell'attività fisica specifica di un sistema fisico specifico (il cervello). Benché questa attività possa essere simulata da un computer, questa non può far sorgere la consapevolezza.

Questa proposizione è dovuta al filosofo Searle e alla sua critica serrata della IA e del Test di Turing, critica esemplificata dal famoso argomento della stanza cinese. Uno dei problemi per chi vuole creare un'intelligenza artificiale è quello di riconoscerla: quale è infatti una definizione accettabile di intelligenza? Turing risolse il problema fornendo una definizione operativa, il famoso Test di Turing: in sintesi, un essere umano X, per assunzione intelligente, viene posto davanti a due consolle attraverso cui può parlare a due soggetti che però non vede. Uno dei due soggetti, indicato con Y, sarà un altro essere umano, l'altro, Z, sarà una macchina, che a differenza di X e Y deve mostrare di avere l'intelligenza. Se, dopo un tempo ragionevole, X non riesce a distinguere Y da Z cioè se non riesce a capire chi è l'uomo e chi la macchina, allora Z ha superato il test e deve essere considerata "intelligente". Searle attaccò a fondo questa argomentazione asserendo che superare il Test di Turing non prova niente sull'intelligenza e soprattutto sulla consapevolezza di Z. Nel suo famoso argomento della stanza cinese, Searle ipotizza che un uomo, diciamo Giovanni, italiano con nessuna conoscenza del cinese, sia chiuso in una stanza per affrontare un Test di Turing. Attraverso una botola riceve dall'esterno strisce di carta con sopra domande espresse in lingua cinese e ovviamente scritte in caratteri cinesi. Giovanni non capisce assolutamente nulla di quanto gli viene chiesto ma fortunatamente è provvisto di manuali che prevedono ogni situazione. Cioè i manuali gli dicono come "costruire" una adeguata risposta ai segni che Giovanni vede sulla carta; in pratica gli dicono: se vedi il segno tal dei tali insieme a … prima di… con sotto il segno…, allora disegna il tale segno … e poi il segno… e poi il segno…. Notare che in pratica Giovanni fa (certo con più tempo e fatica) quello che fa un computer eseguendo un programma, cioè elabora, manipola simboli. Se i manuali/programma di Giovanni sono adeguati può darsi che il Test di Turing sia superato, cioè che il cinese all'esterno riceva risposte appropriate alle sue domande. Tuttavia, dice Searle, è innegabile che Giovanni non ha capito nulla né di quello che gli veniva chiesto né di quello che lui ha "risposto" (qualsiasi manipolazione simbolica non può portare alla comprensione). Notare che molti sostenitori della IA non hanno accettato l'argomento di Searle e appellandosi al carattere emergente dell' intelligenza/consapevolezza, hanno sostenuto che è inessenziale che Giovanni, cioè una parte dell'apparato, capisca o non capisca. Infatti ciò non esclude che l'intero apparato (cioè Giovanni, la penna, i manuali, la stanza…) abbia sviluppato una consapevolezza. Questa affermazione, benché sembri a prima vista paradossale e insostenibile, è però difficilmente attaccabile da un punto di vista logico e operativo.

"The question is not whether intelligent machines can have emotions, but whether machines can be intelligent without any emotions" Minsky, The Society of Mind